06/2023 – Fachartikel Swiss Infosec AG

Eine Betrachtung von ChatGPT als KI-Dienst

1. Einführung

ChatGPT existiert nicht erst seit kurzem, sondern bereits seit 2018. Grosse Bekanntheit erlangte der Chatbot-Dienst bei uns aber erst in den vergangenen Monaten und ist seitdem in aller Munde. Eine Betrachtung der Chancen und Risiken im geschäftlichen Umfeld ist vor allem mit Bezug zur Thematik Informationssicherheit und Datenschutz relevant und wichtig. Fragen wie «Was passiert mit den Informationen, die man im Eingabedialog verwendet?» oder «Was sind die Möglichkeiten, die sich für ein Unternehmen mit Hilfe des Bots ergeben?» muss sich eine Unternehmung stellen und sich über die Antworten Gedanken machen.

Die Fragestellung an ChatGPT selbst, ob schützenswerte Informationen bei ihm sicher sind, beantwortet die AI (artificial intelligence) wie folgt:

Die Antwort gibt das «intelligente» Tool sehr treffend wieder und bezieht sich auch gleich auf das grundsätzliche Problem: es gibt keine absolute Sicherheit, was mit den Informationen passiert. Jeder Benutzer ist selbst dafür verantwortlich, welche Daten er in den Bot eingibt.

Die meisten Benutzer verwenden ChatGPT hauptsächlich dazu, Informationen abzufragen. Also, um zum Beispiel danach zu fragen, wie lange der Nil oder wie hoch das höchste Gebäude der Welt ist. Für solche Fragen eignen sich allerdings Suchmaschinen wie Google, Bing oder DuckDuckGo deutlich besser, da man dort beurteilen kann, aus welcher Quelle die Antwort stammt. ChatGPT stellt eine ganz andere Funktion in den Vordergrund, nämlich die der Generierung und der Erstellung von Texten. Die Stärken des Systems liegen darin, dass man aus wenigen Worten flüssige Texte erzeugen, sehr lange Texte kürzen oder eine Zusammenfassung erstellen kann. Der grosse Entwicklungssprung der KI betrifft also nicht die Informationsvermittlung, sondern die Entwicklung von der Grammatiküberprüfung zum Assistenten für die Texterstellung.

2. Risiken und Chancen

Der Einsatz von neuen Technologien kann generell neue Risiken mit sich bringen. Beispiele für mögliche Risiken sind u.a. Voreingenommenheit (Bias), ethische Herausforderungen, unkontrollierbare / nicht erklärbare Ergebnisse (Black Box), fehlende Robustheit gegenüber neuen Daten oder sogar feindliche Angriffe. Es gilt daher, eine Balance zwischen Innovation und Risikobereitschaft für den Einsatz dieser Technologien zu finden. Zur Identifikation, Beurteilung, Vermeidung und Kontrolle solcher Risiken empfiehlt sich ein risikobasierter Ansatz.

Mögliche Risiken beim Einsatz von ChatGPT:

- Datenschutz und Informationssicherheit: Schützenswerte Informationen (z.B. Personendaten, Betriebsgeheimnisse etc.) können in die falschen Hände geraten. Die eingegebenen schützenswerten Informationen werden von ChatGPT bei Anfragen von anderen Benutzern wiederverwendet und auf diese Weise veröffentlicht.

- Cyberangriffe: Bei Nutzung von ChatGPT für die Entwicklung von Software kann fehlerhafter Code oder im schlimmsten Fall Schadcode eingeschleust werden. Diesen Schadcode kann ein Angreifer bewusst ausnützen.

- Urheberrechtsverletzungen: Die erhaltenen Informationen stammen aus unbekannter Quelle, werden ohne Prüfung verwendet und sind möglicherweise urheberrechtlich geschützt.

- Reputationsrisiko: Die erhaltenen Antworten/Ergebnisse können falsch sein und werden ungeprüft weiterverwendet. Dies kann zu einem Reputationsrisiko für die Unternehmung führen.

- Nichtwissen: Bei der Verwendung eines Chatbots besteht das Risiko, dass auf gestellte Fragen keine Antworten gefunden werden können.

Jede neue Technologie bietet nebst Risiken auch Chancen:

- Steigerung der Effizienz der Prozesse: Ein Chatbot kann die Effizienz von Geschäftsprozessen erhöhen, indem er Routineaufgaben automatisiert: zum Beispiel das Prüfen von Software-Quellcode auf sein Optimierungs- oder Verbesserungspotenzial oder das Generieren von Software-Quellcode. Repetitive Aufgaben, wie zum Beispiel das Erstellen von Texten für eine Offerte oder von Artikeln in Sozialen Medien, kann mit Unterstützung von ChatGPT beschleunigt werden.

- Steigerung der Effizienz des Mitarbeitenden: Ein Chatbot kann dazu beitragen, dass Mitarbeitende sich auf nicht repetitive Aufgaben konzentrieren können und für diese mehr Zeit haben.

- Kosteneinsparungen: Ein Chatbot kann helfen, Personalkosten zu reduzieren, da er rund um die Uhr verfügbar ist und automatisch viele Anfragen bearbeiten kann, ohne dass Mitarbeitende involviert werden müssen, zum Beispiel bei der Interaktion auf der Webseite der Unternehmung.

- Besseres Kundenverständnis: Chatbots wie ChatGPT können dazu beitragen, wertvolle Daten über Kunden und deren Anliegen zu sammeln. Diese Daten können genutzt werden, um Einblicke in das Verhalten und die Bedürfnisse dieser Kunden zu gewinnen und die Marketing- und Vertriebsstrategien einer Unternehmung zu verbessern, zum Beispiel bei der Erstellung und Auswertung von Umfragen.

- Neue Geschäftsfelder: Ein AI-Tool wie ChatGPT kann allenfalls zu neuen Geschäftsideen in einer Unternehmung führen, da neue Sichtweisen auf bekannte Themen entstehen können.

Der verantwortungsvolle Einsatz von AI ist ein interdisziplinäres Forschungsfeld und enthält u.a. Forschungsfragen in technischen, ökonomischen, rechtlichen, sozialwissenschaftlichen und philosophischen Disziplinen. In den letzten Jahren wurden in all diesen Bereichen grosse Fortschritte gemacht (z.B. im Bereich der Erklärbarkeit von Algorithmen, AI Fairness, Verschlüsselung und Kryptographie).

Auch in den nächsten Jahren sind hier grosse Fortschritte zu erwarten. Parallel dazu haben viele Staaten, internationale Standards setzende Organisationen, Unternehmen und Branchenverbände eigene Leitlinien (Principles & Guidelines) für den Einsatz von AI entwickelt. Aktuell laufen vermehrt Initiativen, die solche Leitlinien konkretisieren und operativ anwendbar machen sollen.

3. Technische Betrachtung

Technische Einführung:

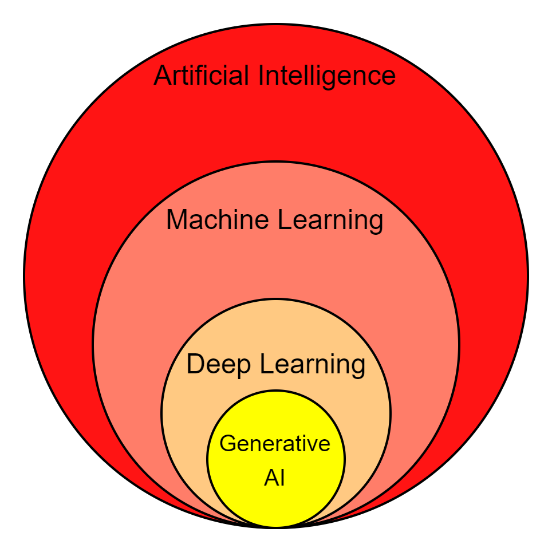

Generell gehört ChatGPT zu einem spezialisierten Bereich der künstlichen Intelligenz, der generativen AI[1]. Die Technologie hat sich im Laufe der Zeit verbessert, aber wir erleben heute eine Beschleunigung aufgrund der stark erhöhten verfügbaren Rechenleistung. Die Geschichte der künstlichen Intelligenz geht zurück auf die 1950er Jahre mit der wegweisenden Veröffentlichung einer Publikation von Alan M. Turing. Das Gebiet des maschinellen Lernens wird mit der Niederlage des Schachgrossmeisters Gary Kasparov gegen IBMs Deep Blue in Verbindung gebracht. Dann im Jahr 2016 hat AlphaGo, ein Deep Learning Algorithmus für das Spiel Go, in vier von fünf Spielen gegen den professionellen südkoreanischen Go-Spieler Lee Sedol gewonnen. Sowohl Deep Blue als auch AlphaGo sind «bloss» Spiel-Algorithmen, trotzdem haben diese gezeigt, dass sie komplexe Aufgaben mindestens genauso gut, meist aber besser als Menschen, ausführen können.

ChatGPT ist ein Service der Firma OpenAI. Diese bietet neben der grundlegenden webbasierten Benutzeroberfläche, die ein Frage- und Antwort-Format verwendet, auch Whisper an, ein auf neuronalem Netz basierendes Spracherkennungssystem. OpenAI bietet auch Anwendungsprogrammierschnittstellen (APIs) an, die es Organisationen ermöglichen, ChatGPT und Whisper nahtlos in verschiedene Anwendungen, Websites, Produkte und Dienstleistungen sowie Sprachschnittstellen zu integrieren. Microsoft zum Beispiel hat in ihrem Suchdienst «Bing» ChatGPT bereits standardmässig eingebaut und stellt dem Benutzer so laufend die neuste Version direkt zur Verfügung.

Sprachmodelle[2] können über verschiedene Optionen wie Chatbot-Schnittstellen, APIs und cloudbasierte Dienste abgerufen werden. Jede Option richtet sich an verschiedene Endbenutzer und zielt auf einzelne Benutzer oder Unternehmenskunden ab. Einige Lösungen bieten aktualisierte Versionen für Einzelpersonen an, während andere für den Geschäftsbetrieb konzipiert sind und aufgrund von Partnerschaften auf bestimmten Cloud-Plattformen verfügbar sein können. Für Unternehmenskunden bieten bestimmte cloudbasierte Dienste sicheren, isolierten Zugriff auf Sprachmodelle über REST-APIs, Software Development Kits (SDKs) oder webbasierte Schnittstellen. Diese Dienste können mit anderen Cloud-Angeboten integriert werden und unterstützen Funktionen wie Virtual Private Networks und verwaltete Identitäten über Verzeichnisdienste.

Während die Technologie weiter voranschreitet, breiten sich die Integrationen von OpenAI und ChatGPT in bemerkenswertem Tempo aus. Viele Anwendungen, Plattformen und Tools nutzen die Leistungsfähigkeit dieser AI-Modelle, um ihre Funktionen und Fähigkeiten zu verbessern. Diese Verbreitung wird auch in der nahen Zukunft stark wachsen und der AI zu einer noch schnelleren Entwicklung verhelfen.

Wo kann ChatGPT bei der Verhinderung von Cyberangriffen helfen?[3]

Nachfolgend ein paar Beispiele, wo ChatGPT und die generative AI gegen Angriffe helfen kann und so die Informationssicherheit unterstützt:

- ChatGPT kann bei der Erklärung von System-Verwundbarkeiten unterstützen und entsprechend Referenzen auf «best practices» zur Minderung oder Behebung dieser Schwachstellen geben.

- ChatGPT kann helfen, Programmiercode, den Entwickler aus dem Internet beziehen (bspw. für oft genutzte Funktionen), auf mögliche Schwachstellen zu analysieren.

- ChatGPT kann helfen, Programmiercode in «normaler» Sprache zu erläutern und zu kommentieren, damit weniger technische Mitarbeiter deren Funktionsweise besser verstehen können.

- ChatGPT kann helfen, Security Patches und ChangeLogs zusammenzufassen und die wichtigsten Sicherheitshinweise, die darin enthalten sind, aufzuzeigen.

- ChatGPT kann helfen, Konfigurationsfiles und Scripts zu analysieren und Erklärungen zu liefern, was diese genau bewirken.

4. Empfehlungen

Ein Unternehmen muss sich mit der Thematik ChatGPT, und wie mit einer solchen Technologie umzugehen ist, auseinandersetzen und dies an seine Mitarbeitenden kommunizieren. Wird das Thema nämlich ignoriert, werden Mitarbeitende diese Möglichkeit der einfachen Texterstellung trotzdem benutzen. Diese unerlaubte Nutzung passiert dann allenfalls ohne Rücksicht auf den Inhalt, der bekannt gegeben wird. Die Unternehmung muss also eine klare Regelung vorgeben, wie mit ChatGPT umzugehen ist.

Eine mögliche Regelung kann sein, die Benutzung zu verbieten und dies zusätzlich auch technisch zu verhindern. Ein Verbot hat allerdings oft eine schlechte Wirkung, so werden solche Dienste dann meistens auf dem privaten Smartphone oder Computer verwendet und das Verbot zumindest technisch umgangen.

Die deutlich bessere Variante ist es, die Benutzung für die Mitarbeitenden freizugeben, dies allerdings nur mit ganz klaren Regeln, was erlaubt und was verboten ist. Auch in diesem Fall ist es aber unerlässlich, die Mitarbeitenden zu sensibilisieren und zu schulen. Was hat Platz im Umgang mit ChatGPT und was ist klar zu unterlassen. Die Awareness im Umgang mit Informationen, ob vertraulich oder nicht, ist ein altes Thema, welches mit ChatGPT und allen «intelligenten» Clouddiensten einen neuen Bezug erhält. Nachfolgend einige Checkpunkte, die in einer Benutzerweisung adressiert werden sollten:

- Es dürfen keine vertraulichen, persönlichen oder geschäftlichen Informationen im Umgang mit ChatGPT verwendet werden. Es wird die Verwendung von anonymisierten Informationen empfohlen bspw. mittels Platzhalter «Mitarbeiter XYZ», auch darf nicht aufgrund des Inhaltes auf eine Person geschlossen werden können, bspw. bei der Redaktion eines Arbeitszeugnisses.

- Dem «System» ChatGPT darf nicht vertraut werden.

- Die von ChatGPT zurückgelieferten Ergebnisse sind immer zu verifizieren.

- Der Dienst darf nur über IKT-Mittel des Unternehmens genutzt werden.

- ChatGPT darf nur in den vom Unternehmen definierten Bereichen, Organisationseinheiten oder Themen verwendet werden.

- Bei der Nutzung von ChatGPT zur Erhöhung der Effizienz (bspw. Softwareentwicklung), sind die Ergebnisse durch eine Drittperson zu verifizieren (bspw. im Rahmen eins Codereviews).

Ein Unternehmen muss sich der Funktionsweise und der Grenzen des Einsatzes von ChatGPT bewusst werden. Dazu gehören auch weitere Punkte:

- Die Mitarbeitenden sind über die Risiken bei der Nutzung von ChatGPT zu sensibilisieren.

- Bei Zusammenarbeit mit Lieferanten oder Dienstleistern ist zu klären, ob diese ChatGPT nutzen. Falls eine Nutzung vorgesehen ist, gilt es sorgfältig abzuwägen, ob die eigenen Daten in einer solchen Nutzung ebenfalls verwendet werden und falls ja, so muss vertraglich geregelt werden, in welchem Umfang welche Daten verarbeitet werden dürfen.

Wie für jede neue Technologie ist auch für ChatGPT oder AI eine Abwägung der Chancen und Risiken durchzuführen und dann der gewünschte Einsatz im Unternehmen zu definieren.

[1] Generative AI beziehungsweise generative künstliche Intelligenz ist ein Dachbegriff für jede Art von automatisiertem Prozess, bei dem Algorithmen eingesetzt werden, um Daten zu erzeugen, zu bearbeiten oder zu synthetisieren.

[2] Als Sprachmodelle werden die verschiedenen Generationen von ChatGPT bezeichnet

[3] https://cloudsecurityalliance.org/artifacts/security-implications-of-chatgpt/

Kontaktieren Sie uns und erfahren Sie in einem unverbindlichen Beratungsgespräch, was unsere Spezialistinnen und Spezialisten für Sie tun können: +41 41 984 12 12, infosec@infosec.ch

Swiss Infosec AG; 26.05.2023

Kompetenzzentrum Consulting